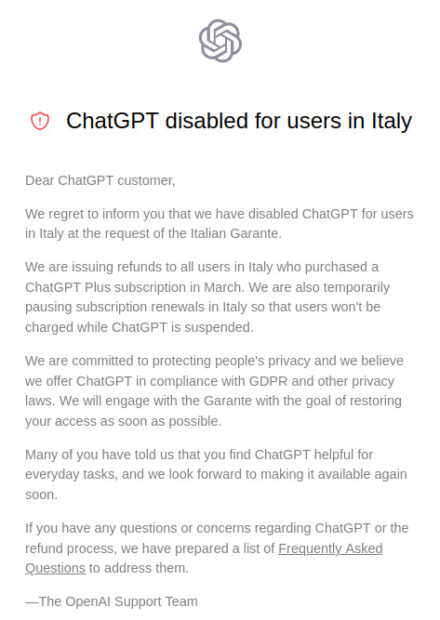

TL;DR Con un provvedimento di urgenza dettato da alcune importanti criticità sul trattamento dei dati personali, il Garante della Privacy ha disposto la limitazione provvisoria del trattamento dei dati personali dall’Italia alla piattaforma ChatGPT che, quindi, ha interdetto l’accesso al servizio dal nostro Paese.

Con un provvedimento del 30 marzo 2023 (n. 112 del 30 marzo 2023), il Garante della privacy Italiano ha imposto a OpenAI L.L.C., società statunitense sviluppatrice e gestrice di ChatGPT, “in qualità di titolare del trattamento dei dati personali effettuato attraverso tale applicazione, la misura della limitazione provvisoria, del trattamento dei dati personali degli interessati stabiliti nel territorio italiano“.

Le motivazioni di una tale decisione sono da ricercarsi nei considerando del provvedimento citato, in ordine sparso e con grassetto mio:

RILEVATO, da una verifica effettuata in merito, che non viene fornita alcuna informativa agli utenti, né agli interessati i cui dati sono stati raccolti da OpenAI, L.L.C. e trattati tramite il servizio di ChatGPT;

RILEVATA l’assenza di idonea base giuridica in relazione alla raccolta dei dati personali e al loro trattamento per scopo di addestramento degli algoritmi sottesi al funzionamento di ChatGPT;

RILEVATO, inoltre, l’assenza di qualsivoglia verifica dell’età degli utenti in relazione al servizio ChatGPT che, secondo i termini pubblicati da OpenAI L.L.C., è riservato a soggetti che abbiano compiuto almeno 13 anni;

CONSIDERATO che l’assenza di filtri per i minori di età di 13 anni espone gli stessi a risposte assolutamente inidonee rispetto al grado di sviluppo e autoconsapevolezza degli stessi;

per concludere che:

RITENUTO che, in assenza di qualsivoglia meccanismo di verifica dell’età degli utenti, nonché, comunque, del complesso delle violazioni rilevate, detta limitazione provvisoria debba estendersi a tutti i dati personali degli interessati stabiliti nel territorio italiano;

Quali sono i dati personali trattati dalla piattaforma ChatGPT? Beh, oltre ai dati tecnici legati sia alla sessione (quindi IP dell’utente, metadati della connessione…) che quelli di gestione e conservazione delle chat (ricordiamo il bug del 20 marzo, poi corretto, che per errore poteva far visualizzare ad altri utenti alcune informazioni riservate come le chat), ci sono i dati sfruttati per l’elaborazione del modello. E su quest’ultimi, anche per motivi di segreto industriale, è difficile capire quali siano seppur sia auspicabile che si tratti solo di dati pubblici.

In ogni caso, trovo le motivazioni della richiesta assolutamente pertinenti, anche se non posso fare a meno di osservare che alcune criticità in alcuni punti, come la verifica dell’età. Parliamo di una criticità di cui si discute da tempo e che sono comuni a gran parte dei servizi Internet, soprattutto i social network. Che una spunta su una checkbox su cui l’utente dichiari la sua età superiore ai 13 anni sia sufficiente? Ne dubito, eppure gran parte dei servizi, quantomeno quelli più noti, le misure di verifica sono di questo tipo. E difficilmente sarà possibile, a meno che di adottare soluzioni diverse e molto più invasive, escogitare verifiche più attendibili.

Sembra vi sia anche un problema di conformità al GDPR da parte dei dati trattati da OpenAI LLC, che lo pone sullo stesso piano di altri servizi offerti da Google e Microsoft ma largamente utilizzati anche in Italia, anche da istituzioni pubbliche. Due pesi e due misure? Oppure qualche servizio è sacrificabile mentre altri, per la loro grandezza e diffusione, purtroppo no?

Domande che mi sto facendo, perché concordo sul fatto che ChatGPT possa rivelarsi un problema per la privacy degli interessati e che il trattamento dei dati deve essere conforme alla normativa. Ma questo dovrebbe avvenire anche per tutti gli altri servizi che trattano dati dei cittadini italiani, piattaforme di collaboration sul cloud incluse.

Seppur questa decisione avrà una importante ricaduta sulla consapevolezza che gli utenti dovrebbero avere per temi importanti come il trattamento dei loro dati personali, trovo francamente esagerata questa misura limitativa decisa dal Garante, alla luce della situazione attuale e pensando – soprattutto! – a quelle realtà italiane che stavano sperimentando l’uso di queste tecnologie per sviluppare business innovativi.

Peraltro, e mi accingo a conclusione, parliamo di un “blocco” facilmente aggirabile (come lo sono tutti i blocchi basati sulla georeferenzazione): chiunque abbia un servizio di VPN con un exit-node posizionato fuori dall’Italia può tranquillamente continuare ad usare ChatGPT senza problemi (ma con ben altri rischi per la privacy dati dall’uso di un singolo canale per il proprio traffico Internet).

Non a caso, nel giro di poche ore sono spuntati siti web e articoli con le istruzioni per aggirare il “limite”, come Unblock ChatGPT 🤌.

Politicamente, quindi, parliamo di una decisione forte e con conseguenze non banali. Tecnicamente, le misure di blocco sono al momento facilmente aggirabili senza particolari sforzi. Chi la spunterà?

1 comment

Interesting article. It is interesting to see what powers governments give themselves by default, in the name of so called “public safety”. I can agree with some of your mentioned points, like age filtering etc. As an IT professional myself, I see the value of AI like ChatGPT, but can also not ignore the possible danger of something like this.

and yes, blocking it is not the answer. any VPN service makes that a useless venture.